Ключевые выводы

- ИИ-фишинг использует машинное обучение и автоматизацию для создания высоко персонализированных, безошибочных атак, которые сложнее обнаружить, чем традиционные попытки фишинга.

- Технология Deepfake для аудио и видео позволяет злоумышленникам убедительно выдавать себя за доверенных лиц, делая проверку голоса и видео ненадежной.

- Протоколы аутентификации электронной почты, такие как DMARC, в сочетании с инструментами обнаружения на базе искусственного интеллекта и постоянным обучением пользователей, обеспечивают наиболее надежную защиту от постоянно развивающихся угроз фишинга с использованием искусственного интеллекта.

Фишинг на протяжении многих лет является наиболее распространенной формой киберпреступности, ущерб от которой оценивается в 160 миллиардов спам-сообщений. С помощью искусственного интеллекта такие атаки превращаются из легко распознаваемых мошенничеств в сложные угрозы, которые трудно обнаружить даже опытным специалистам по безопасности.

Фишинг с использованием искусственного интеллекта — это новая, более совершенная форма атак по электронной почте. Он использует машинное обучение для изучения огромных объемов данных, написания убедительных сообщений, создания поддельных медиафайлов и легкого проведения крупных автоматизированных кампаний. Задачи, которые раньше отнимали у злоумышленников много времени (поиск целей, написание правдоподобных сообщений и их персонализация), теперь могут быть выполнены за считанные секунды с помощью инструментов искусственного интеллекта.

Центр по борьбе с интернет-преступностью ФБР получил 321 136 жалоб на фишинг и спуфинг, что делает их одной из наиболее часто регистрируемых категорий интернет-преступлений. По мере расширения возможностей искусственного интеллекта ожидается, что эти цифры значительно вырастут.

Сейчас как для организаций, так и для отдельных лиц крайне важно понимать, как ИИ меняет характер фишинговых атак и как от них защищаться.

Что такое фишинг с использованием искусственного интеллекта?

AI-фишинг использует искусственный интеллект для создания, персонализации и отправки очень убедительных вредоносных сообщений. В отличие от традиционного фишинга, который полагается на общие шаблоны и очевидные ошибки, AI-фишинг создает контекстуально уместный, грамматически безупречный контент, адаптированный к конкретным целям.

Эти атаки сочетают в себе обработку естественного языка (NLP), интеллектуальный анализ данных и автоматизацию для анализа общедоступной информации о целях (профили в социальных сетях, профессиональные сети, новостные статьи и корпоративные сайты), а затем генерируют высокоперсонализированные сообщения, использующие эти знания. Результатом является фишинговое сообщение , которое выглядит законным, актуальным и срочным.

ИИ-фишинг действует по нескольким каналам, включая электронную почту, SMS (смишинг), социальные сети, платформы для обмена сообщениями и голосовые звонки (вишинг), но безопасность электронной почты является важнейшей первой линией защиты от этих угроз.

Что делает фишинг с использованием ИИ особенно опасным, так это его способность обходить традиционные методы обнаружения. В то время как старые индикаторы фишинга по электронной почте , такие как орфографические ошибки, неловкие формулировки и общие приветствия, когда-то помогали пользователям выявлять угрозы, то создаваемый ИИ контент устраняет эти «красные флажки». Современные фишинговые письма, созданные с помощью ИИ, могут соответствовать или превосходить качество легитимных деловых коммуникаций.

Технология, лежащая в основе фишинга с использованием ИИ, не является новой или особенно дорогой, поскольку многие из тех же инструментов, которые используются для легитимного маркетинга, обслуживания клиентов и создания контента, могут быть перепрофилированы для злонамеренных целей. Такой легкий доступ значительно упростил участие киберпреступников, позволяя даже неопытным злоумышленникам проводить отточенные, профессионально выглядящие фишинговые кампании.

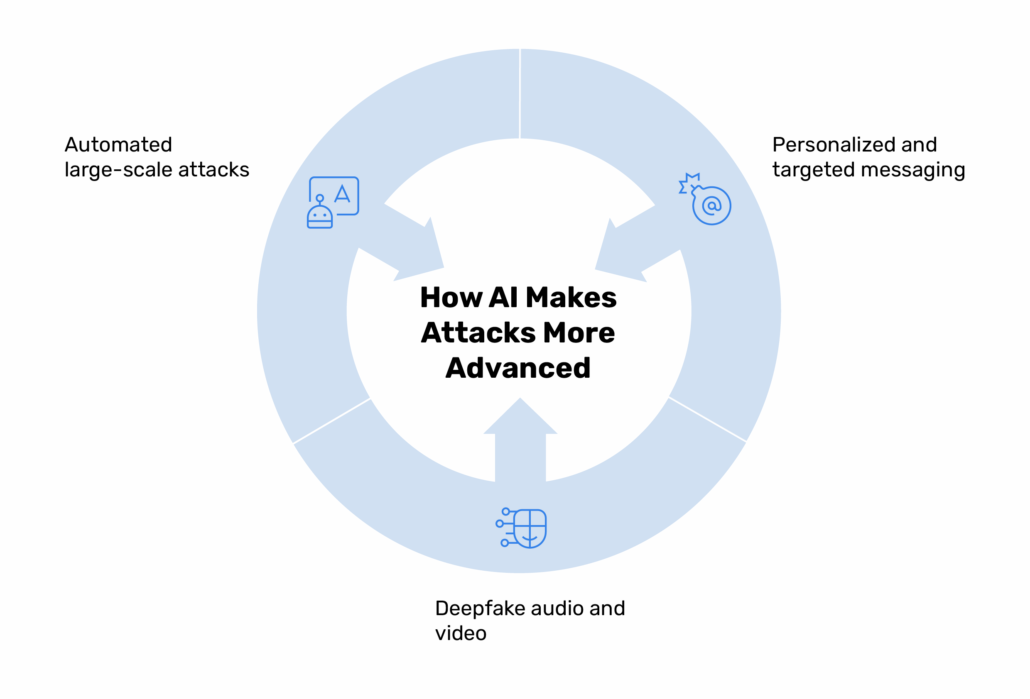

Как искусственный интеллект делает атаки более изощренными

Современный фишинг с использованием искусственного интеллекта основан на анализе огромных объемов данных для понимания целей, генерации естественного и похожего на человеческий языка, создании глубоких поддельных медиа и проведении полностью автоматизированных кампаний. Эти технологии делают атаки более быстрыми, убедительными и гораздо более сложными для обнаружения, чем традиционный фишинг.

Персонализированные и целевые сообщения

ИИ превосходно справляется со сбором и анализом общедоступной информации для создания высокоцелевых специфических фишинговых . С помощью сбора информации из профилей в социальных сетях, профессиональных сетей, таких как LinkedIn, корпоративных веб-сайтов и новостных статей, инструменты ИИ создают подробные профили потенциальных жертв, включая их роли, отношения, интересы, модели коммуникации и текущие проекты.

Имея эту информацию, злоумышленники могут создавать сообщения, в которых упоминаются реальные коллеги, текущие проекты или недавние события, что делает попытку фишинга более правдоподобной и актуальной. Например, система искусственного интеллекта может заметить, что финансовый директор недавно опубликовал сообщение о посещении определенной конференции, а затем сгенерировать фишинговое письмо, выдавая себя за поставщика, с которым он там встретился, и упомянув конкретные сессии и разговоры, которые делают сообщение более аутентичным.

Персонализация выходит за рамки поверхностных деталей. ИИ анализирует стиль письма, словарный запас и коммуникационные шаблоны, чтобы соответствовать ожидаемому тону и формату легитимных сообщений. Если цель обычно получает формальные, подробные электронные письма от своего бухгалтерского отдела, попытка фишинга с помощью ИИ будет отражать этот стиль. Если они привыкли к кратким, неформальным сообщениям от своего менеджера, атака адаптируется соответствующим образом.

Deepfake аудио и видео

Технологии клонирования голоса и синтеза видео значительно продвинулись вперед, что позволяет злоумышленникам создавать убедительный аудио- и видеоконтент, имитирующий голоса и облик доверенных лиц.

Эти дипфейки могут быть созданы на основе относительно небольшого количества исходного материала, иногда всего нескольких минут общедоступного аудио или видео, что делает уязвимыми руководителей, общественных деятелей и всех, кто присутствует в Интернете.

Типичные сценарии, в которых технология deepfake используется в качестве оружия, включают:

- Выдача себя за руководителя: Злоумышленники создают синтезированный аудиозапись, на которой генеральный директор или финансовый директор просят срочно перевести деньги или предоставить конфиденциальную информацию.

- Звонки для проверки поставщиков: Поддельные голоса, сгенерированные искусственным интеллектом, могут имитировать голоса поставщиков или партнеров, чтобы утвердить поддельные счета-фактуры или запросить изменения в платежных реквизитах.

- Чрезвычайные ситуации: Синтетические голоса, выдающие себя за членов семьи или коллег, которые находятся в кризисной ситуации и требуют немедленной финансовой помощи.

- Взлом видеоконференций: Использование видео с глубокой подделкой в виртуальных встречах для подражания участникам и предоставления мошеннических одобрений.

Автоматизированные крупномасштабные атаки

ИИ значительно сокращает время и усилия, необходимые для проведения фишинговых кампаний. В то время как традиционные злоумышленники могут отправлять сотни сообщений в день, системы на базе ИИ могут генерировать и рассылать миллионы уникальных, персонализированных фишинговых попыток за тот же период времени. Google блокирует почти 10 миллионов спам-сообщений каждую минуту, и ожидается, что автоматизация с помощью ИИ значительно увеличит эти объемы.

Автоматизация охватывает весь жизненный цикл атаки:

- Идентификация целей: ИИ сканирует открытые источники данных для выявления ценных целей и потенциальных точек входа.

- Генерация контента: Модели естественного языка создают уникальные сообщения для каждого получателя, исключая обнаружение шаблонов.

- Оптимизация времени: Машинное обучение определяет оптимальное время отправки на основе целевых моделей поведения и часовых поясов.

- Обработка ответов: Чат-боты взаимодействуют с жертвами, которые отвечают на сообщения, поддерживая обман и направляя их к краже учетных данных или установке вредоносного ПО.

- Усовершенствование кампании: ИИ анализирует показатели успешности и автоматически корректирует тактику для улучшения будущих попыток.

Такая автоматизация позволяет злоумышленникам действовать в огромных масштабах, одновременно тестируя тысячи вариантов сообщений и быстро адаптируясь к средствам защиты. Традиционные инструменты безопасности, основанные на фиксированных сигнатурах, с трудом справляются с постоянно меняющимся контентом, генерируемым искусственным интеллектом.

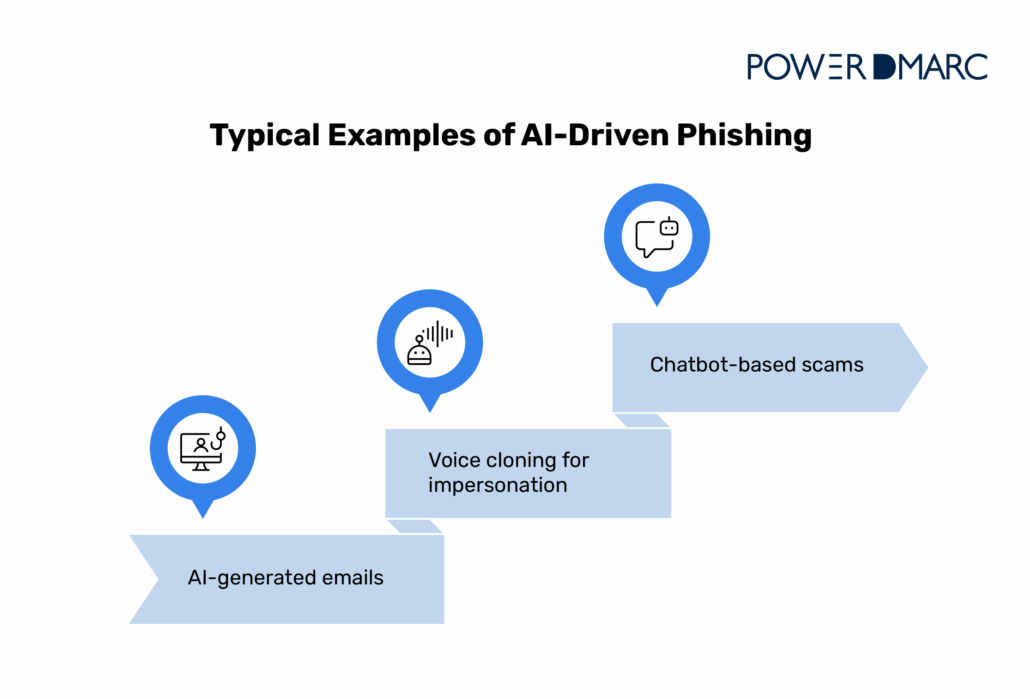

Распространенные примеры фишинга с использованием ИИ

Фишинг с использованием ИИ проявляется в нескольких векторах атак, каждый из которых использует различные уязвимости в психологии человека и технических системах. Понимание этих распространенных методов помогает организациям создавать надлежащие средства защиты.

Электронные письма, созданные с помощью искусственного интеллекта

Электронная почта по-прежнему остается основным каналом доставки фишинговых атак. Фишинговые письма, созданные с помощью искусственного интеллекта, не содержат грамматических ошибок и нелепых формулировок, которые традиционно помогали пользователям выявлять вредоносные сообщения.

Современные инструменты искусственного интеллекта создают электронные письма, которые:

- Соответствие контексту: Сообщения ссылаются на реальные события, проекты или отношения, имеющие отношение к целевой аудитории.

- Профессионально оформлено: Макет, подписи и брендинг соответствуют легитимным корпоративным коммуникациям.

- Стимулируемое срочностью: Контент создает давление, побуждающее действовать быстро, без проверки, используя психологические триггеры.

- Без ошибок: Грамматика, орфография и синтаксис безупречны, что устраняет традиционные «красные флажки».

Фишинговые письма, созданные с помощью искусственного интеллекта, часто выдают себя за отраслевые фишинговые , следуя отраслевым нормам коммуникации, чтобы выглядеть более легитимными. Например, фишинговые письма, созданные с помощью ИИ и нацеленные на медицинские организации, могут ссылаться на соответствие HIPAA или правила хранения данных пациентов, а атаки на финансовые учреждения могут упоминать проверку транзакций или нормативные аудиты.

Клонирование голоса для имитации

Технология синтеза голоса достигла такого уровня, что синтетические голоса практически неотличимы от настоящих записей. Злоумышленники могут клонировать голоса из общедоступных источников, таких как отчеты о доходах, презентации на конференциях, подкасты или видео в социальных сетях, а затем использовать синтетический голос, чтобы выдать себя за руководителей, членов семьи или доверенных коллег.

К ситуациям повышенного риска, в которых клонирование голоса особенно опасно, относятся:

- Последующие действия в случае компрометации деловой электронной почты (BEC): После отправки мошеннического электронного письма с просьбой о банковском переводе злоумышленники звонят, используя клонированный голос руководителя, чтобы «подтвердить» запрос.

- Запросы на выделение средств из чрезвычайного фонда: Синтетические голоса имитируют членов семьи, которые якобы попали в аварию, были арестованы или нуждаются в неотложной медицинской помощи, требующей немедленной оплаты.

- Проверка ИТ-безопасности: Поддельные звонки в службу поддержки с использованием клонированных голосов ИТ-персонала с целью запроса учетных данных или доступа к системе.

- Изменения в платежах поставщиков: Использование имени известных поставщиков для изменения информации о маршрутизации платежей.

Эффективность атак с использованием клонированного голоса обусловлена нашим психологическим доверием к аудиоверификации. Когда электронное письмо вызывает подозрения, многие люди звонят, чтобы проверить его подлинность. Но если злоумышленник предвидит это и предоставляет номер для обратного звонка, по которому можно связаться с сообщником или автоматической системой, использующей клонированный голос, процесс проверки на самом деле усиливает мошенничество, а не раскрывает его.

Мошенничество с использованием чат-ботов

Злонамеренные чат-боты, созданные на основе больших языковых моделей, могут вести длительные и убедительные беседы с жертвами. Они могут постепенно собирать конфиденциальную информацию, притворяясь, что предоставляют реальную клиентскую поддержку или техническую помощь. Эти боты на базе искусственного интеллекта могут:

- Выдача себя за службу поддержки клиентов: Появление в результатах поиска или социальных сетях в качестве «официальных» каналов поддержки, а затем кража учетных данных или платежной информации.

- Проведите социальную инженерию: Установление доверительных отношений в ходе многократных взаимодействий с целью завоевать доверие перед тем, как выдвигать мошеннические требования.

- Обход проверочных вопросов: Использование искусственного интеллекта для генерации правдоподобных ответов на вопросы безопасности на основе общедоступной информации.

- Масштабные взаимодействия: Одновременное взаимодействие с тысячами жертв с помощью персонализированных ответов.

Сложность отличия вредоносных чат-ботов от законных инструментов обслуживания клиентов создает значительный риск. Исследование фишинга в сфере высшего образования показало, что более четверти студентов открывали фишинговые письма, а около половины из тех, кто их открывал, переходили по ссылкам, что демонстрирует, как даже образованные, осведомленные о безопасности пользователи становятся жертвами убедительных взаимодействий.

Как защититься от фишинга с использованием искусственного интеллекта

Защита от фишинга с использованием ИИ требует многоуровневого подхода, сочетающего технические средства контроля, защитные инструменты ИИ и постоянное обучение пользователей. Ни одно отдельное решение не обеспечивает полную защиту, поэтому организации должны внедрять несколько пересекающихся средств защиты для обнаружения и предотвращения этих сложных атак.

Лучшие практики в области безопасности

Фундаментальные меры безопасности остаются критически важными даже в условиях усложнения атак. Организации должны уделять приоритетное внимание следующим аспектам:

- Протоколы аутентификации электронной почты: Внедрите SPF, DKIM и DMARC для предотвращения подделки домена и проверки личности отправителя. PowerDMARC обеспечивает автоматическую настройку и мониторинг, чтобы сделать аутентификацию доступной для организаций любого размера.

- Многофакторная аутентификация (MFA): Требуйте MFA для всех учетных записей, особенно для тех, которые имеют финансовые или административные привилегии. Даже если учетные данные будут украдены с помощью фишинга, MFA обеспечит дополнительный барьер.

- Процедуры проверки: Установите четкие процедуры проверки запросов с высоким уровнем риска, таких как банковские переводы, изменение учетных данных или доступ к конфиденциальным данным, через независимые каналы, а не путем ответа на подозрительные электронные письма или использования предоставленной контактной информации.

- Архитектура нулевого доверия: Внедрите модели безопасности с нулевым доверием, которые проверяют каждый запрос на доступ независимо от источника, ограничивая боковое перемещение, если злоумышленники получат первоначальный доступ.

- Регулярные обновления безопасности: Обновляйте операционные системы, приложения и программное обеспечение безопасности, чтобы устранить известные уязвимости, которые могут быть использованы для фишинговых атак после первоначального взлома.

- Доступ с минимальными привилегиями: Ограничьте права пользователей только тем, что необходимо для выполнения их функций, чтобы снизить потенциальный ущерб от взлома учетных записей.

IBM сообщила, что утечки данных обходятся организациям в среднем примерно в 4,4 млн долларов долларов США за каждый инцидент в 2025 году, что делает инвестиции в комплексные меры безопасности финансово оправданными.

Инструменты безопасности с искусственным интеллектом

Традиционная защита электронной почты должна быть дополнена DMARC и искусственным интеллектом для противодействия фишингу и компрометации деловой электронной почты, основанным на искусственном интеллекте. Оборонительные инструменты искусственного интеллекта могут:

- Анализируйте модели коммуникации: Обнаруживайте аномалии в поведении отправителя, содержании сообщения или моделях запросов, которые указывают на потенциальный фишинг.

- Выявление синтетических медиа: Используйте машинное обучение для обнаружения поддельных аудио- и видеофайлов по мелким артефактам и несоответствиям.

- Обнаружение угроз в режиме реального времени: Непрерывный мониторинг почтового трафика с целью выявления подозрительных ссылок, вложений или доменов до того, как сообщения дойдут до пользователей.

- Автоматический ответ: Карантин подозрительных сообщений, оповещение служб безопасности и предотвращение кражи учетных данных в режиме реального времени.

Платформа PowerDMARC поддерживает безопасность электронной почты по принципу «нулевого доверия», обеспечивая соблюдение политик DMARC и проверяя личность отправителя, что помогает организациям блокировать поддельные электронные письма до того, как они попадают в почтовые ящики. Организации могут сэкономить до 300 000 долларов в год , внедрив DMARC для уменьшения убытков от поддельных писем и фишинга.

Основная сила безопасности на базе искусственного интеллекта заключается в его способности обнаруживать новые, незнакомые атаки. В то время как инструменты на основе сигнатур пропускают постоянно меняющиеся сообщения, генерируемые искусственным интеллектом, защитный искусственный интеллект изучает новые угрозы и постоянно адаптируется. Во многих случаях сочетание передовой аутентификации электронной почты с детектором искусственного интеллекта может дополнительно помочь в выявлении шаблонов контента, генерируемого машинами, и пометке подозрительных сообщений до того, как они нанесут вред.

Обучение сотрудников и пользователей

Одной только технологией невозможно предотвратить все фишинговые атаки, поэтому человеческое суждение остается важным элементом защиты. Однако только 13% целевых сотрудников сообщают о попытках фишинга, что ограничивает возможности организаций реагировать на вторжения и предупреждать других.

Эффективные программы по повышению осведомленности о безопасности должны:

- Сосредоточьтесь на современных тактиках: Обновите обучение, выйдя за рамки традиционных индикаторов фишинга, чтобы учитывать контент, созданный с помощью искусственного интеллекта, дипфейки и сложные методы социальной инженерии.

- Обеспечьте реалистичные симуляции: Используйте симулированные фишинговые кампании, отражающие современные методы угроз, измеряя реакцию пользователей и предоставляя немедленную обратную связь.

- Уделите особое внимание протоколам проверки: Обучите сотрудников проверять необычные запросы через независимые каналы, особенно в случае финансовых транзакций или изменений учетных данных.

- Создайте культуру информирования: Упростите процесс сообщения о подозрительных сообщениях и поощряйте сотрудников сообщать о них, не опасаясь позора или обвинений.

- Поддерживайте постоянную вовлеченность: Проводите регулярные обновления обучения по мере развития угроз; повышение осведомленности о безопасности — это непрерывный процесс.

Будущее искусственного интеллекта в кибербезопасности

Гонка в области искусственного интеллекта в сфере кибербезопасности набирает обороты. Злоумышленники и защитники используют передовые технологии машинного обучения, и по мере того, как инструменты искусственного интеллекта для фишинга становятся все более простыми в использовании и мощными, системы защиты должны развиваться с такой же скоростью.

Ожидаемые разработки в области безопасности на основе искусственного интеллекта включают:

- Поведенческая биометрия: Системы, которые проверяют личность на основе манеры набора текста, движений мыши и других поведенческих характеристик, которые сложно воспроизвести искусственному интеллекту.

- Обнаружение дипфейков в реальном времени: Усовершенствованные алгоритмы, которые анализируют аудио и видео в режиме реального времени во время звонков и конференций, предупреждая участников о синтетических медиа.

- Прогнозируемая аналитика угроз: Системы искусственного интеллекта, которые предсказывают возможные схемы атак на основе активности в даркнете, раскрытия уязвимостей и поведения злоумышленников.

- Автоматическое реагирование на инциденты: Машинное обучение, которое обнаруживает, изолирует и устраняет фишинговые атаки без вмешательства человека, сокращая время реагирования с нескольких часов до нескольких секунд.

- Персонализированные средства контроля безопасности: Адаптивные системы, которые корректируют требования безопасности в зависимости от контекста риска, такого как местоположение, устройство, модели поведения и чувствительность запросов.

Поскольку ИИ делает атаки более убедительными и масштабируемыми, защитники должны внедрять комплексные многоуровневые программы безопасности, сочетающие в себе аутентификацию, обнаружение, реагирование и обучение. Ни одна отдельная технология или подход не обеспечивает полную защиту от развивающейся угрозы фишинга с использованием ИИ.

Организации, которые понимают возможности и ограничения как наступательного, так и оборонительного ИИ и соответственно инвестируют в комплексные программы безопасности, будут иметь наилучшие возможности для защиты от известных фишинговых атак и возникающие угрозы в ближайшие годы.

Итоги

Использование искусственного интеллекта в фишинге — это серьезное изменение в методах работы киберпреступников. Оно выводит фишинг на новый уровень масштабирования, персонализации и сложности, с которым традиционные средства безопасности не могут справиться. Фишинг, созданный с помощью искусственного интеллекта, часто выглядит более убедительно, чем сообщения, написанные людьми, технология deepfake быстро распространяется, и организации во всех секторах теперь сталкиваются с растущими рисками, связанными с этими сложными атаками.

Но защита возможна. Организации, которые внедряют комплексные программы безопасности, сочетающие протоколы аутентификации электронной почты, такие как DMARC, инструменты обнаружения на базе искусственного интеллекта, многофакторную аутентификацию и постоянное обучение пользователей, могут значительно снизить свою уязвимость перед фишинговыми атаками с использованием искусственного интеллекта. Ключ к успеху — понимание того, что ни одно решение не обеспечивает полную защиту; для эффективной защиты требуется несколько пересекающихся уровней.

PowerDMARC предлагает платформу аутентификации на основе DMARC, сочетающую SPF, DKIM, мониторинг и отчетность, чтобы предотвратить спуфинг и фишинг. Наши инструменты делают аутентификацию электронной почты доступной для организаций любого размера, помогая вам создать надежную первую линию защиты от угроз, основанных на искусственном интеллекте.

Если вы готовы усилить безопасность своей электронной почты от фишинга с использованием искусственного интеллекта, начните с проверки текущего состояния аутентификации и выявления уязвимостей, прежде чем злоумышленники воспользуются ими. Надежная безопасность электронной почты начинается с прозрачности и контроля — двух вещей, которые обеспечивает PowerDMARC предоставляет с самого первого дня.

Часто задаваемые вопросы (FAQ)

Искусственный интеллект чаще используется для фишинга на мобильных устройствах или на компьютерах?

Искусственный интеллект в равной степени нацелен на обе платформы, хотя мобильные пользователи могут быть более уязвимы из-за меньшего размера экранов, на которых скрываются данные отправителя, и меньшего количества визуальных индикаторов безопасности.

Какие отрасли чаще всего становятся мишенью фишинговых атак с использованием искусственного интеллекта?

Финансовые услуги, здравоохранение, технологии и государственный сектор подвергаются наибольшему риску атак из-за ценных данных, хотя малые предприятия во всех отраслях все чаще сталкиваются с угрозами фишинга с использованием искусственного интеллекта.

- compauth=fail: обзор композитной аутентификации Microsoft - 1 июня 2026 г.

- Достаточно ли Windows Defender для обеспечения безопасности малого бизнеса? - 14 мая 2026 г.

- Объяснение DMARCbis — что меняется и как подготовиться - 16 апреля 2026 г.