Kluczowe wnioski

- Phishing oparty na sztucznej inteligencji wykorzystuje uczenie maszynowe i automatyzację do tworzenia wysoce spersonalizowanych, pozbawionych błędów ataków, które są trudniejsze do wykrycia niż tradycyjne próby phishingu.

- Technologia deepfake audio i wideo umożliwia atakującym przekonujące podszywanie się pod zaufane osoby, co sprawia, że weryfikacja głosowa i wideo staje się niewiarygodna.

- Protokoły uwierzytelniania poczty elektronicznej, takie jak DMARC, w połączeniu z narzędziami wykrywania opartymi na sztucznej inteligencji i ciągłym szkoleniem użytkowników, zapewniają najsilniejszą ochronę przed ewoluującymi zagrożeniami związanymi z phishingiem wykorzystującym sztuczną inteligencję.

Phishing od lat jest najczęstszą formą cyberprzestępczości, której wartość szacuje się na 160 miliardów spamowych wysyłanych codziennie na całym świecie. Obecnie sztuczna inteligencja przekształca te ataki z łatwych do wykrycia oszustw w wyrafinowane zagrożenia, które nawet świadomi zagrożeń profesjonaliści mają trudności z identyfikacją.

Phishing oparty na sztucznej inteligencji to nowsza, bardziej zaawansowana forma ataków e-mailowych. Wykorzystuje on uczenie maszynowe do analizowania ogromnych ilości danych, pisania przekonujących wiadomości, tworzenia fałszywych mediów i łatwego przeprowadzania dużych, zautomatyzowanych kampanii. Zadania, które wcześniej zajmowały atakującym dużo czasu (badanie celów, pisanie wiarygodnych wiadomości i personalizowanie ich), można teraz wykonać w ciągu kilku sekund za pomocą narzędzi AI.

Centrum Skarg Dotyczących Przestępstw Internetowych FBI otrzymało 321 136 skarg dotyczących phishingu i spoofingu, co czyni je jedną z najczęściej zgłaszanych kategorii przestępstw internetowych. Wraz z rozwojem możliwości sztucznej inteligencji oczekuje się, że liczby te znacznie wzrosną.

Obecnie zarówno organizacje, jak i osoby prywatne muszą zrozumieć, w jaki sposób sztuczna inteligencja zmienia ataki phishingowe i jak się przed nimi bronić.

Czym jest phishing AI?

Phishing oparty na sztucznej inteligencji wykorzystuje sztuczną inteligencję do tworzenia, personalizowania i wysyłania bardzo przekonujących wiadomości zawierających złośliwe oprogramowanie. W przeciwieństwie do tradycyjnego phishingu, który opiera się na ogólnych szablonach i zawiera oczywiste błędy, phishing oparty na sztucznej inteligencji generuje treści dostosowane do kontekstu, poprawne gramatycznie i dostosowane do konkretnych celów.

Ataki te łączą przetwarzanie języka naturalnego (NLP), eksplorację danych i automatyzację w celu analizy publicznie dostępnych informacji o potencjalnych ofiarach (profilach w mediach społecznościowych, sieciach zawodowych, artykułach prasowych i stronach internetowych firm), a następnie generują wysoce spersonalizowane wiadomości, które wykorzystują tę wiedzę. Efektem tego jest wiadomość phishingowa , która wydaje się wiarygodna, trafna i pilna.

Phishing wykorzystujący sztuczną inteligencję działa w wielu kanałach, w tym w wiadomościach e-mail, SMS-ach (smishing), mediach społecznościowych, platformach komunikacyjnych i połączeniach głosowych (vishing), ale bezpieczeństwo poczty elektronicznej stanowi kluczową pierwszą linię obrony przed tymi zagrożeniami.

To, co sprawia, że phishing wykorzystujący sztuczną inteligencję jest szczególnie niebezpieczny, to jego zdolność do omijania tradycyjnych metod wykrywania. W przypadku starszych wskaźniki phishingu w wiadomościach e-mail , takie jak błędy ortograficzne, niezręczne sformułowania i ogólne pozdrowienia, pomagały użytkownikom zidentyfikować zagrożenia, treści generowane przez sztuczną inteligencję eliminują te sygnały ostrzegawcze. Nowoczesne wiadomości e-mailowe wykorzystujące sztuczną inteligencję mogą dorównywać lub przewyższać jakość legalnej komunikacji biznesowej.

Technologia stojąca za phishingiem opartym na sztucznej inteligencji nie jest nowa ani szczególnie kosztowna, ponieważ wiele narzędzi wykorzystywanych w legalnym marketingu, obsłudze klienta i tworzeniu treści można wykorzystać do celów złośliwych. Łatwy dostęp sprawił, że cyberprzestępcom znacznie łatwiej jest się zaangażować, umożliwiając nawet niedoświadczonym atakującym prowadzenie dopracowanych, profesjonalnie wyglądających kampanii phishingowych.

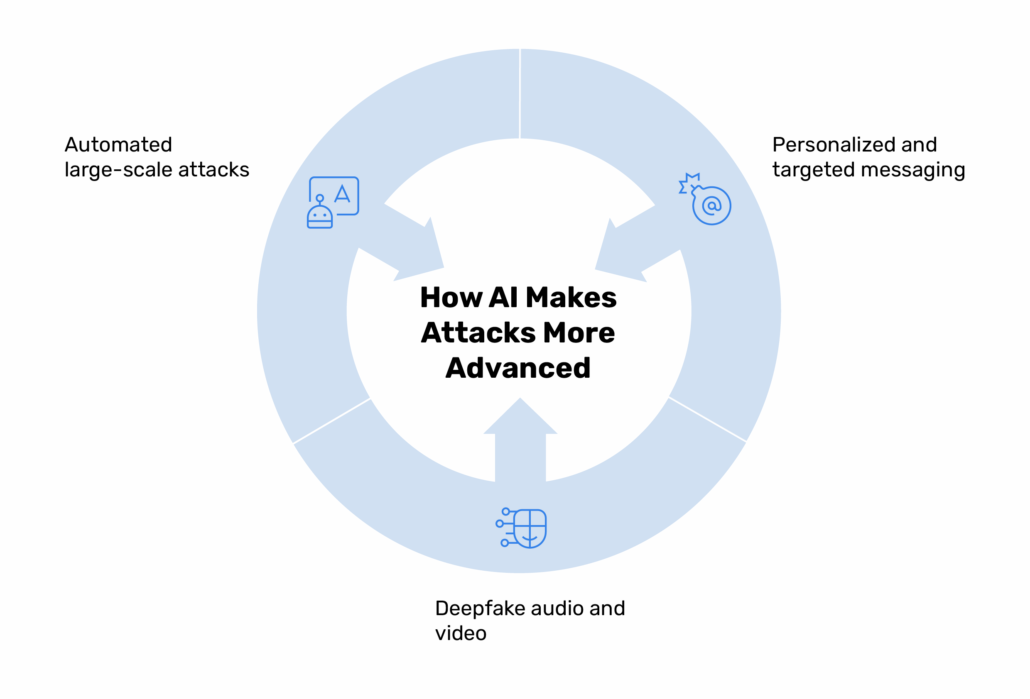

W jaki sposób sztuczna inteligencja umożliwia bardziej wyrafinowane ataki

Nowoczesny phishing oparty na sztucznej inteligencji polega na analizowaniu ogromnych ilości danych w celu zrozumienia celów, generowaniu naturalnego i podobnego do ludzkiego języka, tworzeniu mediów typu deepfake oraz prowadzeniu w pełni zautomatyzowanych kampanii. Technologie te sprawiają, że ataki są szybsze, bardziej przekonujące i znacznie trudniejsze do wykrycia niż tradycyjny phishing.

Spersonalizowane i ukierunkowane wiadomości

Sztuczna inteligencja doskonale radzi sobie z gromadzeniem i analizowaniem informacji publicznych w celu tworzenia wysoce ukierunkowanych ataki typu spear phishing . Dzięki przeszukiwaniu profili w mediach społecznościowych, sieciach zawodowych, takich jak LinkedIn, stronach internetowych firm i artykułach prasowych, narzędzia AI tworzą szczegółowe profile potencjalnych ofiar, w tym ich role, relacje, zainteresowania, wzorce komunikacyjne i bieżące projekty.

Dzięki tym informacjom osoby atakujące mogą tworzyć wiadomości, w których wspominają prawdziwych współpracowników, bieżące projekty lub ostatnie wydarzenia, co sprawia, że próba phishingu wydaje się wiarygodna i istotna. Na przykład system AI może zauważyć, że dyrektor finansowy opublikował niedawno informację o uczestnictwie w określonej konferencji, a następnie wygenerować wiadomość phishingową podszywającą się pod dostawcę, którego spotkał na tej konferencji, odwołując się do konkretnych sesji i rozmów, które sprawiają, że wiadomość wydaje się autentyczna.

Personalizacja wykracza poza szczegóły powierzchniowe. Sztuczna inteligencja analizuje styl pisania, słownictwo i wzorce komunikacyjne, aby dopasować się do oczekiwanego tonu i formatu prawdziwych wiadomości. Jeśli dana osoba zazwyczaj otrzymuje formalne, szczegółowe wiadomości e-mail od działu księgowości, próba phishingu przeprowadzona przez sztuczną inteligencję będzie odzwierciedlać ten styl. Jeśli jest ona przyzwyczajona do krótkich, nieformalnych wiadomości od swojego przełożonego, atak zostanie odpowiednio dostosowany.

Fałszywe nagrania audio i wideo

Technologie klonowania głosu i syntezy wideo znacznie się rozwinęły, umożliwiając atakującym tworzenie przekonujących treści audio i wideo, które podszywają się pod zaufane osoby.

Te deepfake'i można stworzyć z niewielkiej ilości materiałów źródłowych, czasem tylko kilku minut publicznie dostępnych nagrań audio lub wideo, co sprawia, że są one zagrożeniem dla kadry kierowniczej, osób publicznych i każdego, kto jest aktywny w sieci.

Typowe scenariusze, w których technologia deepfake jest wykorzystywana jako broń, obejmują:

- Podszywanie się pod członków kadry kierowniczej: Atakujący tworzą syntetyczny zapis głosowy prezesa lub dyrektora finansowego, w którym proszą o pilne przelewy lub poufne informacje.

- Połączenia weryfikacyjne dostawców: Fałszywe głosy generowane przez sztuczną inteligencję mogą naśladować głosy dostawców lub partnerów w celu zatwierdzenia fałszywych faktur lub żądania zmian w szczegółach płatności.

- Sytuacje awaryjne: Syntetyczne głosy podające się za członków rodziny lub współpracowników znajdujących się w sytuacji kryzysowej, domagające się natychmiastowej pomocy finansowej.

- Infiltracja wideokonferencji: Wirtualne spotkania wykorzystujące fałszywe filmy wideo do podszywania się pod uczestników i uzyskiwania nieprawidłowych zatwierdzeń.

Zautomatyzowane ataki na dużą skalę

Sztuczna inteligencja znacznie ogranicza czas i wysiłek potrzebny do przeprowadzenia kampanii phishingowych. Podczas gdy tradycyjni atakujący mogą wysyłać setki wiadomości dziennie, systemy oparte na sztucznej inteligencji mogą wygenerować i rozesłać miliony unikalnych, spersonalizowanych prób phishingu w tym samym czasie. Google blokuje prawie 10 milionów wiadomości spamowych na minutę, a automatyzacja oparta na sztucznej inteligencji ma znacznie zwiększyć tę liczbę.

Automatyzacja obejmuje cały cykl życia ataku:

- Identyfikacja celów: sztuczna inteligencja skanuje publiczne źródła danych w celu identyfikacji wartościowych celów i potencjalnych punktów wejścia.

- Generowanie treści: Modele języka naturalnego tworzą unikalne wiadomości dla każdego odbiorcy, eliminując wykrywanie oparte na szablonach.

- Optymalizacja czasu: Uczenie maszynowe określa optymalne czasy wysyłania na podstawie wzorców zachowań docelowych odbiorców i stref czasowych.

- Obsługa odpowiedzi: Chatboty wchodzą w interakcję z ofiarami, które odpowiadają, podtrzymując oszustwo i kierując je w stronę kradzieży danych uwierzytelniających lub instalacji złośliwego oprogramowania.

- Udoskonalenie kampanii: Sztuczna inteligencja analizuje wskaźniki sukcesu i automatycznie dostosowuje taktykę, aby poprawić przyszłe próby.

Tego rodzaju automatyzacja pozwala atakującym działać na ogromną skalę, testując jednocześnie tysiące wariantów wiadomości i szybko dostosowując się do zabezpieczeń. Tradycyjne narzędzia bezpieczeństwa, które opierają się na stałych sygnaturach, mają trudności z nadążaniem za generowaną przez sztuczną inteligencję treścią, która nieustannie się zmienia.

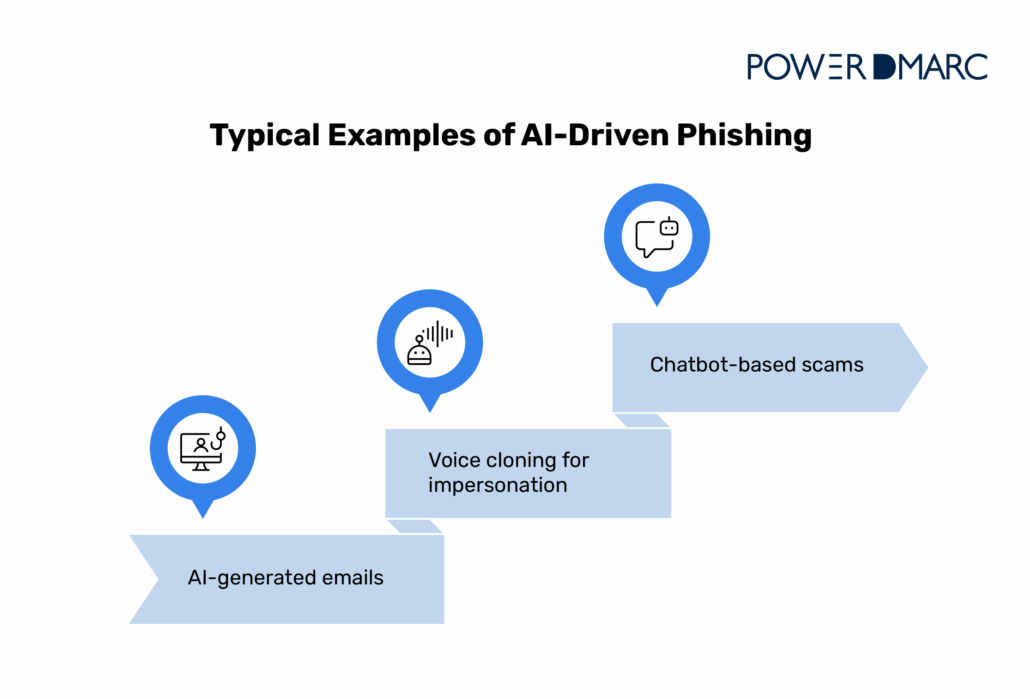

Typowe przykłady phishingu wykorzystującego sztuczną inteligencję

Phishing wykorzystujący sztuczną inteligencję przejawia się w wielu wektorach ataku, z których każdy wykorzystuje różne słabe punkty ludzkiej psychologii i systemów technicznych. Zrozumienie tych powszechnych technik pomaga organizacjom w tworzeniu odpowiednich zabezpieczeń.

E-maile generowane przez sztuczną inteligencję

E-mail pozostaje głównym kanałem dostarczania ataków phishingowych. Generowane przez sztuczną inteligencję wiadomości phishingowe eliminują błędy gramatyczne i niezręczne sformułowania, które tradycyjnie pomagały użytkownikom identyfikować złośliwe wiadomości.

Nowoczesne narzędzia AI tworzą wiadomości e-mail, które są:

- Odpowiednie do kontekstu: Komunikaty odnoszą się do rzeczywistych wydarzeń, projektów lub relacji istotnych dla odbiorcy.

- Profesjonalnie sformatowane: Układ, podpisy i branding odpowiadają legalnej komunikacji korporacyjnej.

- Kierowanie się pilnością: Treść wywiera presję, aby działać szybko, bez weryfikacji, wykorzystując czynniki psychologiczne.

- Bezbłędny: Gramatyka, ortografia i składnia są bezbłędne, co eliminuje tradycyjne problemy językowe.

Wiadomości phishingowe generowane przez sztuczną inteligencję często podszywają się pod wzorce phishingu , stosując normy komunikacyjne właściwe dla danego sektora, aby wyglądały na bardziej wiarygodne. Na przykład phishing generowany przez sztuczną inteligencję, skierowany do organizacji opieki zdrowotnej, może odnosić się do zgodności z HIPAA lub przepisów dotyczących danych pacjentów, podczas gdy ataki na instytucje finansowe mogą wspominać o weryfikacji transakcji lub audytach regulacyjnych.

Klonowanie głosu w celu podszywania się pod inne osoby

Technologia syntezy głosu osiągnęła poziom, na którym syntetyczne głosy są niemal nie do odróżnienia od prawdziwych nagrań. Atakujący mogą klonować głosy z publicznie dostępnych źródeł, takich jak konferencje dotyczące wyników finansowych, prezentacje konferencyjne, podcasty lub filmy w mediach społecznościowych, a następnie wykorzystywać syntetyczny głos do podszywania się pod członków kadry kierowniczej, członków rodziny lub zaufanych współpracowników.

Sytuacje wysokiego ryzyka, w których klonowanie głosu jest szczególnie niebezpieczne, obejmują:

- Kontynuacja ataków typu „Business Email Compromise” (BEC): Po wysłaniu fałszywej wiadomości e-mail z prośbą o przelew bankowy, atakujący dzwonią, używając sklonowanego głosu kierownika, aby „zweryfikować” prośbę.

- Wnioski o środki z funduszu awaryjnego: Syntetyczne głosy podszywają się pod członków rodziny, twierdząc, że ulegli wypadkowi, zostali aresztowani lub znajdują się w nagłym wypadku medycznym wymagającym natychmiastowej płatności.

- Weryfikacja bezpieczeństwa IT: Fałszywe połączenia do pomocy technicznej z wykorzystaniem sklonowanych głosów pracowników działu IT w celu uzyskania danych uwierzytelniających lub dostępu do systemu.

- Zmiany dotyczące płatności dostawców: Podszywanie się pod znanych dostawców w celu zmiany informacji dotyczących trasy płatności.

Skuteczność ataków polegających na klonowaniu głosu wynika z naszego psychologicznego zaufania do weryfikacji słuchowej. Gdy wiadomość e-mail wydaje się podejrzana, wiele osób dzwoni, aby ją zweryfikować. Jeśli jednak osoba atakująca przewiduje taką reakcję i podaje numer, pod który można oddzwonić, aby połączyć się ze wspólnikiem lub automatycznym systemem wykorzystującym sklonowany głos, proces weryfikacji w rzeczywistości wzmacnia oszustwo, zamiast je ujawnić.

Oszustwa oparte na chatbotach

Złośliwe chatboty oparte na dużych modelach językowych mogą prowadzić długie, przekonujące rozmowy z ofiarami. Mogą one powoli gromadzić poufne informacje, udając, że oferują prawdziwą obsługę klienta lub wsparcie techniczne. Te oparte na sztucznej inteligencji boty mogą:

- Podszywanie się pod obsługę klienta: Pojawianie się w wynikach wyszukiwania lub mediach społecznościowych jako „oficjalne” kanały pomocy, a następnie kradzież danych uwierzytelniających lub informacji dotyczących płatności.

- Stosowanie socjotechniki: Budowanie relacji poprzez wielokrotne interakcje w celu zdobycia zaufania przed złożeniem fałszywych wniosków.

- Omijanie pytań weryfikacyjnych: Wykorzystanie sztucznej inteligencji do generowania wiarygodnych odpowiedzi na pytania zabezpieczające w oparciu o publicznie dostępne informacje.

- Interakcje na dużą skalę: Jednoczesne angażowanie tysięcy ofiar za pomocą spersonalizowanych odpowiedzi.

Trudność w odróżnieniu złośliwych chatbotów od legalnych narzędzi obsługi klienta stwarza poważne ryzyko. Badanie dotyczące phishingu w szkolnictwie wyższym wykazało, że ponad jedna czwarta studentów otwierała wiadomości phishingowe, a około połowa z tych osób klikała w linki, co pokazuje, że nawet wykształceni i świadomi zagrożeń użytkownicy padają ofiarą przekonujących interakcji.

Jak chronić się przed phishingiem wykorzystującym sztuczną inteligencję

Obrona przed phishingiem wykorzystującym sztuczną inteligencję wymaga wielopoziomowego podejścia łączącego środki kontroli technicznej, narzędzia obronne oparte na sztucznej inteligencji oraz ciągłą edukację użytkowników. Żadne pojedyncze rozwiązanie nie zapewnia pełnej ochrony, dlatego organizacje muszą wdrażać wiele nakładających się na siebie zabezpieczeń, aby wykrywać i zapobiegać tym wyrafinowanym atakom.

Najlepsze praktyki w zakresie bezpieczeństwa

Podstawowe praktyki bezpieczeństwa pozostają kluczowe, nawet jeśli ataki stają się coraz bardziej wyrafinowane. Organizacje powinny nadać priorytet następującym kwestiom:

- Protokoły uwierzytelniania poczty elektronicznej: Wdrożenie protokołów SPF, DKIM i DMARC w celu zapobiegania fałszowaniu domen i weryfikacji tożsamości nadawcy. PowerDMARC zapewnia automatyczną konfigurację i monitorowanie, aby uwierzytelnianie było dostępne dla organizacji każdej wielkości.

- Uwierzytelnianie wieloskładnikowe (MFA): Wymagaj uwierzytelniania wieloskładnikowego dla wszystkich kont, zwłaszcza tych z uprawnieniami finansowymi lub administracyjnymi. Nawet jeśli dane uwierzytelniające zostaną skradzione poprzez phishing, uwierzytelnianie wieloskładnikowe stanowi dodatkową barierę.

- Procedury weryfikacyjne: Ustal jasne procedury weryfikacji wniosków wysokiego ryzyka, takich jak przelewy bankowe, zmiany danych uwierzytelniających lub dostęp do danych wrażliwych, za pośrednictwem niezależnych kanałów, a nie poprzez odpowiadanie na podejrzane wiadomości e-mail lub korzystanie z podanych danych kontaktowych.

- Architektura zero-trust: Wdrożenie modeli bezpieczeństwa opartych na zasadzie zerowego zaufania, które weryfikują każde żądanie dostępu niezależnie od źródła, ograniczając ruch boczny w przypadku uzyskania przez atakujących początkowego dostępu.

- Regularne aktualizacje zabezpieczeń: Aktualizuj systemy operacyjne, aplikacje i oprogramowanie zabezpieczające, aby wyeliminować znane luki w zabezpieczeniach, które mogą zostać wykorzystane przez ataki phishingowe po początkowym naruszeniu bezpieczeństwa.

- Dostęp z minimalnymi uprawnieniami: Ogranicz uprawnienia użytkowników tylko do tych, które są niezbędne do wykonywania ich zadań, zmniejszając potencjalne szkody wynikające z naruszenia bezpieczeństwa kont.

IBM poinformował, że naruszenia bezpieczeństwa danych kosztują organizacje średnio około 4,4 mln dolarów na incydent w 2025 r., co sprawia, że inwestycje w kompleksowe środki bezpieczeństwa są uzasadnione finansowo.

Narzędzia bezpieczeństwa wzbogacone o sztuczną inteligencję

Tradycyjne zabezpieczenia poczty elektronicznej muszą zostać wzbogacone o protokół DMARC i wykrywanie oparte na sztucznej inteligencji, aby przeciwdziałać phishingowi i atakom typu Business Email Compromise wykorzystującym sztuczną inteligencję. Narzędzia defensywne oparte na sztucznej inteligencji mogą:

- Analizuj wzorce komunikacji: Wykrywaj anomalie w zachowaniu nadawcy, treści wiadomości lub wzorcach żądań, które mogą wskazywać na potencjalny phishing.

- Rozpoznawanie syntetycznych mediów: Wykorzystaj uczenie maszynowe do wykrywania fałszywych plików audio i wideo poprzez subtelne artefakty i niespójności.

- Wykrywanie zagrożeń w czasie rzeczywistym: Ciągłe monitorowanie ruchu poczty elektronicznej, identyfikowanie podejrzanych linków, załączników lub domen, zanim wiadomości dotrą do użytkowników.

- Automatyczna reakcja: Kwarantanna podejrzanych wiadomości, powiadamianie zespołów ds. bezpieczeństwa i zapobieganie kradzieży danych uwierzytelniających w czasie rzeczywistym.

Platforma PowerDMARC wspiera bezpieczeństwo poczty elektronicznej oparte na modelu zero-trust poprzez egzekwowanie zasad DMARC i weryfikację tożsamości nadawcy, pomagając organizacjom blokować fałszywe wiadomości e-mail, zanim trafią one do skrzynek odbiorczych. Organizacje mogą zaoszczędzić nawet około 300 000 dolarów rocznie , wdrażając DMARC w celu ograniczenia strat spowodowanych fałszowaniem i phishingiem.

Główną zaletą zabezpieczeń opartych na sztucznej inteligencji jest ich zdolność do wykrywania nowych, nieznanych ataków. Podczas gdy narzędzia oparte na sygnaturach nie są w stanie wykryć stale zmieniających się wiadomości generowanych przez sztuczną inteligencję, defensywna sztuczna inteligencja analizuje nowe zagrożenia i nieustannie się dostosowuje. W wielu przypadkach połączenie zaawansowanego uwierzytelniania wiadomości e-mail z detektorem opartym na sztucznej inteligencji może dodatkowo pomóc w identyfikacji wzorców treści generowanych przez maszyny i oznaczaniu podejrzanych wiadomości, zanim spowodują one szkody.

Szkolenia pracowników i użytkowników

Sama technologia nie jest w stanie zapobiec wszystkim atakom phishingowym, dlatego ludzka ocena sytuacji pozostaje kluczową warstwą obrony. Jednak tylko 13% pracowników, którzy padli ofiarą ataku, zgłasza próby phishingu, co ogranicza zdolność organizacji do reagowania na włamania i ostrzegania innych.

Skuteczne programy podnoszenia świadomości w zakresie bezpieczeństwa powinny:

- Skup się na nowoczesnych taktykach: Zaktualizuj szkolenia wykraczające poza tradycyjne wskaźniki phishingu, aby uwzględnić treści generowane przez sztuczną inteligencję, deepfake'i i zaawansowane techniki socjotechniczne.

- Zapewnij realistyczne symulacje: Wykorzystaj symulowane kampanie phishingowe, które odzwierciedlają aktualne techniki zagrożeń, mierząc reakcje użytkowników i zapewniając natychmiastową informację zwrotną.

- Podkreślaj protokoły weryfikacyjne: Przeszkol pracowników, aby weryfikowali nietypowe wnioski za pośrednictwem niezależnych kanałów, zwłaszcza w przypadku transakcji finansowych lub zmian danych uwierzytelniających.

- Stwórz kulturę zgłaszania: Ułatw zgłaszanie podejrzanych wiadomości i zachęcaj pracowników do zgłaszania ich bez obawy o zawstydzenie lub obwinianie.

- Utrzymuj stałe zaangażowanie: Regularnie aktualizuj szkolenia w miarę ewolucji zagrożeń; świadomość bezpieczeństwa to proces ciągły.

Przyszłość sztucznej inteligencji w bezpieczeństwie cybernetycznym

Wyścig w dziedzinie sztucznej inteligencji w cyberbezpieczeństwie nabiera tempa. Zarówno atakujący, jak i broniący się wykorzystują zaawansowane technologie uczenia maszynowego, a ponieważ narzędzia phishingowe oparte na sztucznej inteligencji stają się coraz łatwiejsze w użyciu i coraz potężniejsze, systemy obronne muszą ewoluować równie szybko.

Oczekiwane zmiany w zakresie bezpieczeństwa opartego na sztucznej inteligencji obejmują:

- Biometria behawioralna: Systemy weryfikujące tożsamość na podstawie wzorców pisania, ruchów myszą i innych cech behawioralnych, które są trudne do odtworzenia przez sztuczną inteligencję.

- Wykrywanie deepfake'ów w czasie rzeczywistym: Zaawansowane algorytmy analizujące dźwięk i obraz w czasie rzeczywistym podczas rozmów i konferencji, ostrzegające uczestników o syntetycznych mediach.

- Prognozowanie zagrożeń: Systemy sztucznej inteligencji, które przewidują pojawiające się wzorce ataków na podstawie aktywności w dark web, ujawnionych luk w zabezpieczeniach i zachowań atakujących.

- Zautomatyzowana reakcja na incydenty: Uczenie maszynowe, które wykrywa, izoluje i eliminuje ataki phishingowe bez interwencji człowieka, skracając czas reakcji z kilku godzin do kilku sekund.

- Spersonalizowane mechanizmy kontroli bezpieczeństwa: Systemy adaptacyjne, które dostosowują wymagania bezpieczeństwa w oparciu o kontekst ryzyka, taki jak lokalizacja, urządzenie, wzorce zachowań i wrażliwość żądań.

Ponieważ sztuczna inteligencja sprawia, że ataki są bardziej przekonujące i skalowalne, osoby odpowiedzialne za ochronę muszą wdrożyć kompleksowe, wielowarstwowe programy bezpieczeństwa, które łączą uwierzytelnianie, wykrywanie, reagowanie i edukację. Żadna pojedyncza technologia ani podejście nie zapewnia pełnej ochrony przed ewoluującym zagrożeniem związanym z phishingiem wykorzystującym sztuczną inteligencję.

Organizacje, które rozumieją możliwości i ograniczenia zarówno ofensywnej, jak i defensywnej sztucznej inteligencji i odpowiednio inwestują w kompleksowe programy bezpieczeństwa, będą miały najlepszą pozycję do ochrony przed znanych ataków phishingowych i pojawiających się zagrożeń w nadchodzących latach.

Podsumowanie

Phishing oparty na sztucznej inteligencji stanowi znaczącą zmianę w sposobie działania cyberprzestępców. Wprowadza on nowy poziom skali, personalizacji i wyrafinowania, z którym tradycyjne narzędzia bezpieczeństwa mają trudności. Phishing generowany przez sztuczną inteligencję jest często bardziej przekonujący niż wiadomości napisane przez ludzi, technologia deepfake szybko się rozprzestrzenia, a organizacje we wszystkich sektorach stoją obecnie w obliczu rosnącego ryzyka związanego z tymi zaawansowanymi atakami.

Ale obrona jest możliwa. Organizacje, które wdrażają kompleksowe programy bezpieczeństwa, łączące protokoły uwierzytelniania poczty elektronicznej, takie jak DMARC, narzędzia wykrywania oparte na sztucznej inteligencji, uwierzytelnianie wieloskładnikowe i ciągłe szkolenia użytkowników, mogą znacznie zmniejszyć swoje narażenie na ataki phishingowe wykorzystujące sztuczną inteligencję. Kluczem do sukcesu jest uświadomienie sobie, że żadne pojedyncze rozwiązanie nie zapewnia całkowitej ochrony; skuteczna obrona wymaga wielu nakładających się na siebie warstw.

PowerDMARC oferuje platformę uwierzytelniającą opartą na DMARC, łączącą SPF, DKIM, monitorowanie i raportowanie w celu powstrzymania spoofingu i phishingu. Nasze narzędzia sprawiają, że uwierzytelnianie wiadomości e-mail jest dostępne dla organizacji każdej wielkości, pomagając w budowaniu silnej pierwszej linii obrony przed zagrożeniami opartymi na sztucznej inteligencji.

Jeśli chcesz wzmocnić bezpieczeństwo poczty elektronicznej przed phishingiem opartym na sztucznej inteligencji, zacznij od sprawdzenia obecnego stanu uwierzytelniania i zidentyfikowania słabych punktów, zanim wykorzystają je atakujący. Silne zabezpieczenia poczty elektronicznej zaczynają się od widoczności i kontroli, czyli dwóch rzeczy PowerDMARC zapewnia od samego początku.

Często zadawane pytania (FAQ)

Czy phishing wykorzystujący sztuczną inteligencję jest bardziej powszechny na urządzeniach mobilnych czy komputerach?

Phishing wykorzystujący sztuczną inteligencję atakuje obie platformy w równym stopniu, chociaż użytkownicy urządzeń mobilnych mogą być bardziej narażeni ze względu na mniejsze ekrany, które ukrywają szczegóły nadawcy, oraz mniejszą liczbę wizualnych wskazówek dotyczących bezpieczeństwa.

Jakie branże są najczęściej celem ataków phishingowych wykorzystujących sztuczną inteligencję?

Sektory usług finansowych, opieki zdrowotnej, technologii i administracji rządowej są najczęściej atakowane ze względu na cenne zasoby danych, chociaż małe przedsiębiorstwa we wszystkich branżach coraz częściej stają w obliczu zagrożeń związanych z phishingiem wykorzystującym sztuczną inteligencję.

- Aktualizacja specyfikacji DKIM2: Co nowego w projekcie IETF z maja 2026 r. - 25 maja 2026 r.

- Czy program Windows Defender wystarczy do zapewnienia bezpieczeństwa w małej firmie? - 14 maja 2026 r.

- DMARCbis – co się zmienia i jak się przygotować - 16 kwietnia 2026 r.